#34- L'intelligenza artificiale superumana avanza velocemente

È ormai chiaro a tutti che l'AI intende sostituire le nostre capacità cognitive, non solamente a potenziarle. Quando ci riesce parliamo di AI superumana.

Siamo ancora abbastanza lontani da questo, tuttavia la velocità di sviluppo dei sistemi AI è talmente alta che la data del suo sorpasso sulle capacità umane si avvicina rapidamente.

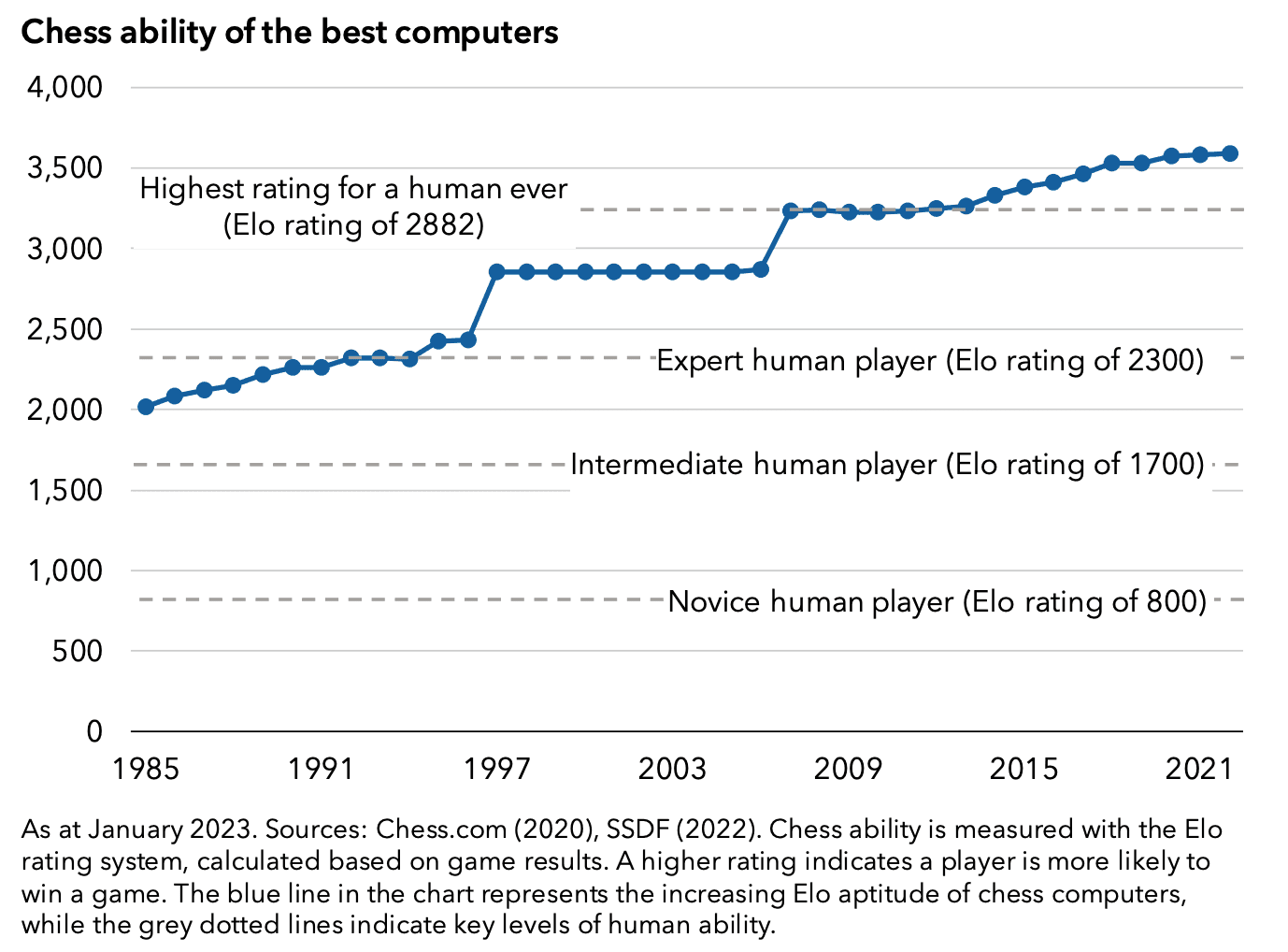

In alcuni ambiti specifici, il sorpasso è avvenuto da diverso tempo. Per esempio, nella storica competizione tra umani computer nel gioco degli scacchi il sorpasso è avvenuto dopo il 2015, quando il software Deep Blue ha iniziato superare in modo continuativo i migliori giocatori del mondo.

N.B.: questo articolo non è un prova pratica sull'AI come nel caso di miei articoli precedenti e come farò ancora. È uno strappo alla regola che serve e chiarire, per quanto possibile, l'idea stessa di Intelligenza Artificiale e soprattutto le sua linee evolutive.

Di che cosa stiamo parlando quando diciamo Intelligenza Artificiale?

Purtroppo la cosa è molto complessa e non è semplicissimo essere chiari. Riprendo qui tre definizioni ampiamente accettate. Poi vedremo i diversi livelli dall'AI.

Large Language Model (LLM)

Un Large Language Model un software in grado analizzare e comprendere un testo. Può cogliere le complessità del linguaggio naturale con in a precisione spesso sorprendente. Per fare questo i LLMs devono essere addestrati attraverso la lettura di moltissime fonti, come articoli, libri e ricerche. Esattamente come si fa per educare un essere umano alla cultura.

Intelligenza Artificiale Generativa

L’ AI Generativa è un tipo di Intelligenza Artificiale in grado di generare nuovi contenuti che possono essere di vario tipo; per esempio testi, audio, immagini, video, codice informatico. Sono contenuti che in precedenza si basavano sulla creatività dell’uomo. L’ AI Generativa si propone come sostituto della creatività umana.

AGI - Intelligenza Artificiale Generale

(Definizione da AWS. Vai al sito AWS per approfondire): l'AGI è un campo di ricerca teorica sull'intelligenza artificiale che tenta di creare software dotato di un'intelligenza simile a quella umana e della capacità di autoapprendimento. L'obiettivo è sviluppare software che sia capace di eseguire attività per le quali non è stato specificamente addestrato o sviluppato.

Quali sono vari livelli possibili dell'AI?

Google sta studiando molto a fondo le possibilità dell'Ai perché è evidente che il motori di ricerca tradizionali potrebbero non reggere il confronto. Lo stesso Web potrebbe non esistere più tra qualche anno, almeno nella forma che conosciamo ora.

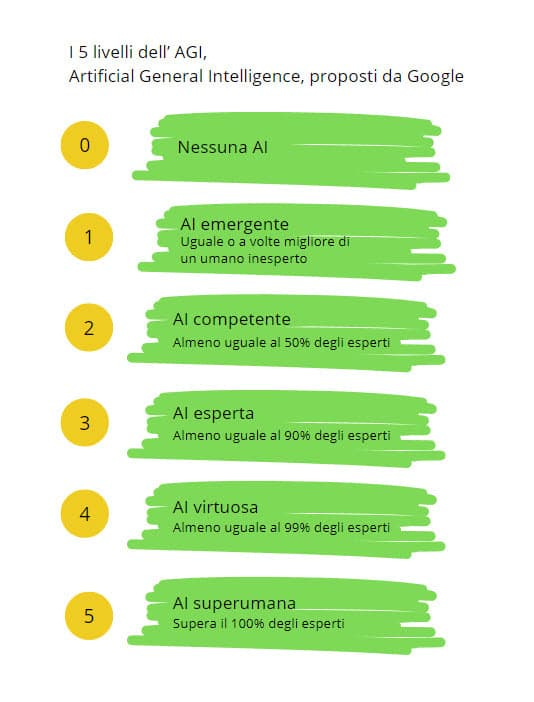

I ricercatori di Google ci propongono 6 livelli di Intelligenza Generale, da prendere come scala di riferimento per valutare le capacità dei vari strumenti AI che si stanno evolvendo.

L'Articolo completo è complesso, ma di grande valore. Se il tema ti interessa lo puoi leggere qui: Position: Levels of AGI for Operationalizing Progress on the Path to AGI

Devo la scoperta di questo studio a "La cultura del dato" di Stefano Gatti, che ringrazio molto per il suggerimento..

Se prendiamo in considerazione compiti intelligenti di carattere generale, i sistemi AI attualmente disponibili si collocano ancora molto in basso su questa scala, al livello 1 AI Emergente.

Le cose però cambiano un modo radicale se si considerano ambiti di applicazione specializzati e ben definiti. In questo caso caso abbiamo già sistemi AI sicuramente superumani.

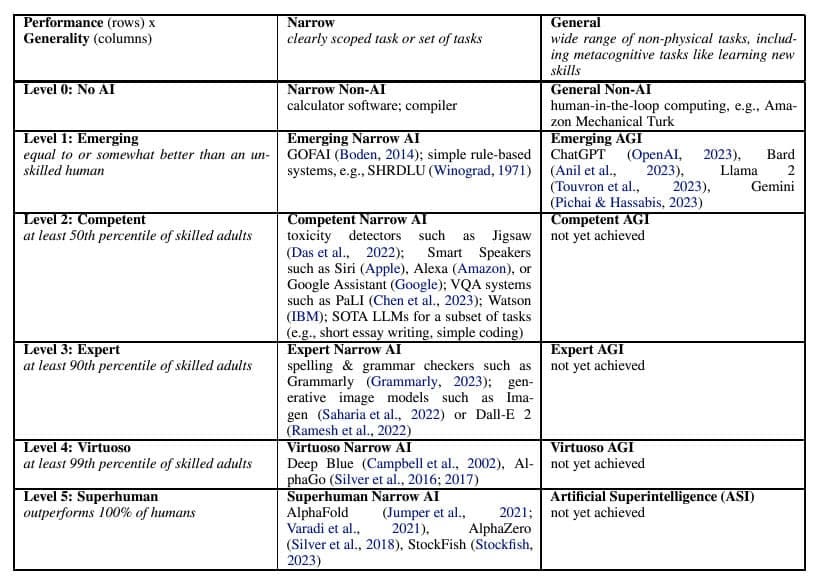

Ecco la tabella originale:

La differenza tra le due colonne di destra è notevole. I ricercatori ci avvertono che:

I sistemi generali che funzionano ampiamente a un livello N possono essere in grado di eseguire un sottoinsieme ristretto di compiti a livelli più alti. Il livello “AGI Competente”, che non è stato raggiunto da nessun sistema pubblico al momento della stesura di questo articolo, corrisponde al meglio a molte concezioni precedenti di AGI e, una volta raggiunto, potrebbe innescare un rapido cambiamento sociale.

Un'altra cosa che che ti faccio osservare in questa tabella è che il livello ZERO comprende il i computer tradizionali.

Qui mi permetto di dissentire.

Suggerisco che qualunque macchina in grado di fare 2+2 dovrebbe essere considerata intelligente. Anche le prime calcolatrici da tavolo a manovella. Un bambino medio di quattro anni non riesce a fare 2+2. Sul piano della sola intelligenza numerica è meno intelligente di questa macchinetta.

Il punto NON è l'intelligenza, ma il fatto di essere oggetti oppure esseri viventi.

Qualunque cosa si intenda per Intelligenza Artificiale dovrebbe essere sempre chiaro almeno che non stiamo parlando di un essere vivente.

Ma vediamo ora il livello superumano non vivente, cioè è la cosa che ci interessa e anche ci spaventa di più.

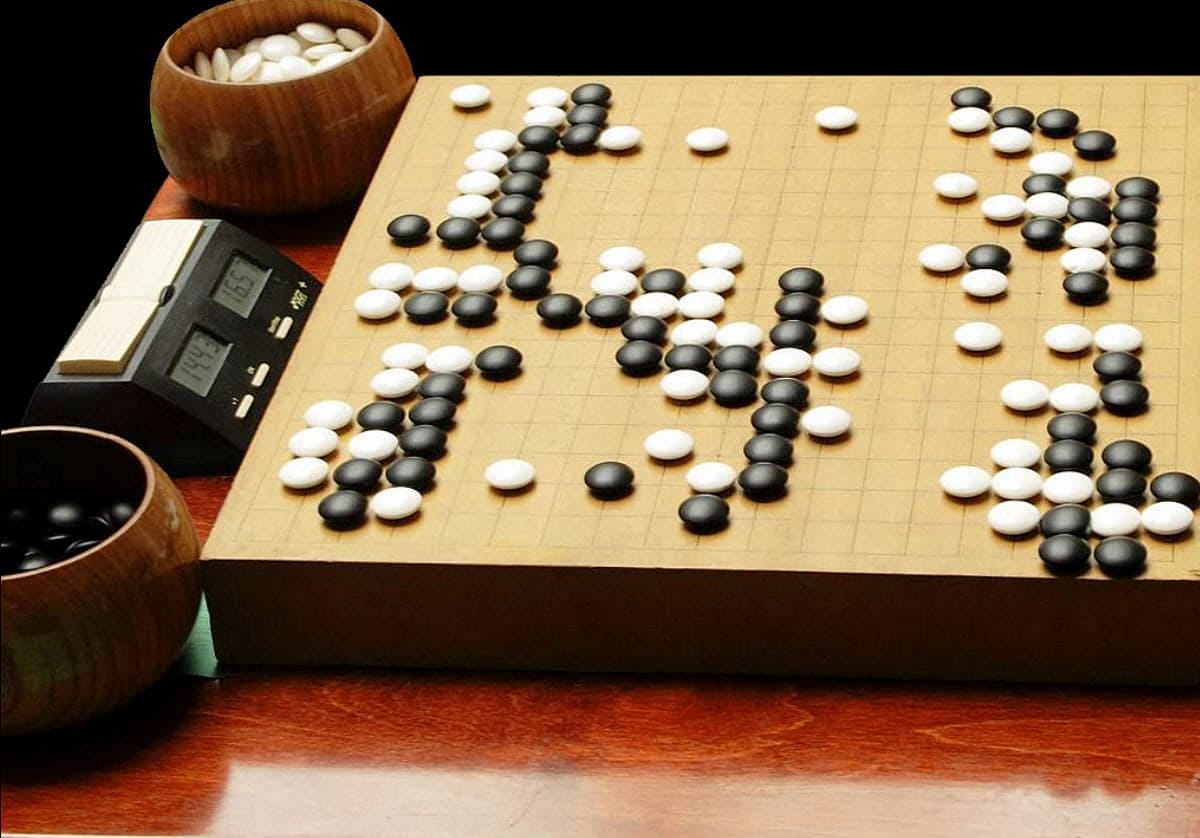

Il caso degli scacchi e del gioco del GO

La prima vittoria di un computer (chiamato Deep Blue) contro il campione del mondo di scacchi allora in carica. Garry Ksasparov. Risale al lontanissimo 1996. Preistoria. Da allora la superiorità del software in abito scacchistico non ha fatto altro che aumentare e ora è del tutto super-umana.

Puoi leggere l'articolo completo qui.

Quella vittoria negli scacchi però si è basata inizialmente sulla potenza di calcolo "bruta" e non su i processi di apprendimento che caratterizzano l'AI.

La cosa è diversa per il gioco del GO

Il GO è molto diverso dagli scacchi. Per vincere al GO è necessario un approccio più "estetico" che rigidamente razionale.

Si pensava che i software non potessero riuscire nell'impresa. Invece ci sono riusciti senza dubbio dal 2017 con la vittoria ripetuta del programma Alpa Go sul super campione coreano Lee Se-dol, che poi decise di ritirarsi dal gioco professionale.

Ma la novità vera è AlphaGo Zero

La novità vera è qui è stata la comparsa di una nuova versione di Alpa Go, chiamata AlphaGo Zero. Questo programma è stato addestrato facendolo giocare contro la precedente versione di sé stesso, sfruttando le sua capacità di apprendere dall'esperienza.

Alpha Go aveva infatti imparato il Go studiando oltre 100.000 partite giocate dagli umani. Alpha Go Zero si è resa in un certo senso più indipendente: si è messa a giocare da sola. Dopo tre giorni di gioco forsennato con se stessa, è riuscita a sconfiggere Alpha Go 100 a 0. (Citato da qui)

A questo punto siamo nell'ambito del "sovraumano". Un campo aperto e sostanzialmente ancora inesplorato. Qui la maestria è diventata una qualità del software e nessun essere umano può competere.

Gli esseri umani sono ora esclusi dai processi di apprendimento che pure hanno "innescato" da apprendisti stregoni. La sfida diventa una meta-sfida, tra programmatori che fanno giocare tra loro i software che hanno prodotto.

Per saperne di più l'intera storia è riassunta qui.

L' AI ci aiuta scegliere o decide al posto nostro?

C'è una differenza abbastanza chiara tra scegliere e decidere.

Prendi il menù di un ristorante. In questo caso puoi scegliere che cosa ordinare.

Se sei in proprietario del ristorante invece devi decidere che cosa inserire nel menù.

Se usi un motore di ricerca vedrai tutti i ristoranti della zona con varie informazioni su di essi. Poi tu scegli. L' AI invece sceglie al posto tuo è ti fornisce una sintesi del suo lavoro.

Con quali criteri? Questo non è mai chiaro per l'utilizzatore finale.

Se voglio sapere qual è il miglior ristorante di pesce nelle vicinanze avrò una risposta però questa riposta potrebbe essere il risultato di un sofisticata azione di promozione del ristorante e non una valutazione basata sulla qualità della cucina.

Potrebbe anche essere una "allucinazione" cioè una risposta data dall'AI anche senza avere i dati necessari. Una cosa da tenere presente che l'AI non assaggia mai i piatti che ti consiglia.

Si basa su giudizi che trova in rete. Una parte di questi potrebbero essere prodotti da una persona umana che assaggia tutti piatti del ristorante, ma è molto improbabile. Nella maggior parte dei casi si tratta di giudizi, basati su altri giudizi, basati su altri giudizi e così via. Tanto vale scegliere il ristorante a caso basandoti sul profumo che aleggia nei dintorni.

Google sta sperimentando da tempo AI Overviews, (panoramiche google) cioè il suo sistema per chiedere a Google di googlare al posto tuo. Non è ancora disponibile per il grande pubblico europeo e non funziona ancora benissimo, ma è questione di tempo. Poco tempo.

Questi sistemi non sono supporti alla capacità decisionale umana. Sono sostituti.

Passiamo dai ristoranti ai carri armanti

Abbiamo capito che nella terribile guerra di Gaza (e quindi anche nelle altre) i bersagli sono scelti in l'aiuto dell'AI. O forse è l’AI che sceglie i bersagli con l'aiuto degli umani?

Se per colpire un comandate nemico si mettono in conto vittime civili, quante sono "accettabili" e per chi? Alla fine sono i sistemi AI che decidono.

Un carro armato è un enorme potenziamento della capacità distruttiva umana. Ma lo controlla il suo equipaggio. Oggi però può essere controllato da un sistema AI e funzionare anche senza equipaggio. Un carro armato controllato dall'AI non ha più controllo umano diretto.

Gli umani lo "lanciano" ma poi il carro (o armi simili, come droni e cani-robot) è in grado di apprendere e prende decisioni autonome.

I ricercatori di google sembrano ben consapevoli di questo e ci allertano sui rischi:

l’AGI è vista da alcuni come un concetto per identificare il punto in cui ci sono rischi estremi (...) poiché alcuni ipotizzano che i sistemi AGI potrebbero essere in grado di ingannare e manipolare , accumulare risorse, portare avanti obiettivi, comportarsi in modo agente, superare in astuzia gli umani in ampi domini, spostare gli umani da ruoli chiave e/o auto-migliorarsi ricorsivamente.

Tuttavia non hanno alcun potere decisionale sullo sviluppo e sull'utilizzo dei sistemi AI. Il problema qui è che sostanzialmente nessuno lo ha.

È in corso da tempo una competizione sfrenata tra aziende e tra stati per la supremazia in campo AI. Secondo Andrea Signorelli, giornalista di Domani, nel numero del 24 maggio 2024, negli Stati Uniti sono state fondate 4.643 startup di AI in 10 anni per 249 miliardi di dollari di investimenti, mentre Francia, Germania e Regno Unito assieme arrivano appena sopra le 1.000 startup per 32 miliardi. Poco si sa di Cina e Russia.

Nessuno può seriamente pensare che questo sistema possa essere "regolato" da qualcuno, stati compresi, o che preoccupazioni di tipo etico contino qualcosa in un ambiente economico e socio-tecnico come questo.

Vedi anche

#32 -Intelligenza artificiale maneggiare con cura!

#33 - La corsa al Second Brain

L'intelligenza artificiale capisce davvero o risponde come se capisse? (di Nello Cristianini)